|

|

大平台,低接入,大市场:百度Apollo2.0自动驾驶共享平台 大平台 2018年3月31日,由百度主办,佐思产研、佐智汽车承办的《Hello Apollo,自动驾驶公开课》第三期——“Apollo2.0自动驾驶平台—技术解析与应用”在北京中关村创业大街车库咖啡成功举办,吸引了300多位来自车企、零部件厂商、软件公司、自动驾驶初创企业的开发者参加。

低接入 Apollo已成为最流行的自动驾驶开发平台,运行平台搭建门槛从几万降低到5000元,

长沙智能驾驶研究院产品部负责人黄英君

智行者科技是一家清华背景的无人车初创企业,活动中联合创始人&技术研发部总监李晓飞分享了《低速自动驾驶专用车产品落地之智行者-Apollo合作案例》,在本次公开课上介绍了低速自动驾驶车开发面临的问题和挑战,特别介绍了如何利用Apollo在高精度地图和仿真平台,加快实现低速自动驾驶专用车的产品落地。

智行者科技联合创始人李晓飞

百度自动驾驶事业部资深架构师杨凡 杨凡:非常高兴有机会跟大家分享百度Apollo“云和端”的研发模式,接着帮助大家了解Apollo2.0演示方式的实战以及车辆与循迹自动驾驶能力的实战;之后是本次公开课的核心部分,障碍物识别和路径规划能力的实战;在此基础上介绍云端训练平台训练红绿灯感知能力,这是使用云端算法来加强自动驾驶能力的实战;最后简要介绍用云端仿真能力来完成验证实战。

现在的AI自动驾驶能力来自云端,所以在云端要采用大量的数据,进行标注和训练。以红绿灯为例,来解释AI的训练过程。一辆车在路上行驶,在安全方面严苛的要求,这种要求远远超过了对传统汽车一般性的要求。要完成一套自动驾驶系统的安全性测试,如果利用100辆车,7×24小时的跑,大概要一百年才能够测试完成。所以绝不是依靠真车来完成自动驾驶测试的,90%的测试工作需要在云端,通过仿真技术大规模的验证实车能力,才能保证它的安全。 正因为要保证自动驾驶的安全是一件长期而艰难的事情,是一个复杂的系统工程,所以百度自动驾驶采取了开放策略。百度在自动驾驶方面做了长时间的探索,做的越久,就越发敬畏自动驾驶和汽车产业。一辆车有上万个零件组成,自动驾驶更不是一个简单的产业环节,而是一个完整的产业链条,包括主机厂、零部件、通讯、感知、决策和控制系统等厂商。所以我们认为它是一个生态,大家在一个完整的生态环境中,找寻自己的位置,合作完成自动驾驶系统的开发。

大市场 所以百度提出了Apollo开放战略计划。百度把多年积累的自动驾驶研究成果开放给生态链,让大家可以共享技术和数据,在此基础上实现资源共享。使用的越多,分享的越多,大家收获的越多,在生态里实现共赢。

Apollo技术框架由4层构成。分别是: Reference Vehicle Platform(参考车辆平台,指一辆能够受电子信号控制的车,我们管它叫线控车) Reference Hardware Platform (参考硬件平台,包含计算单元、GPS/IMU、Camera、激光雷达、毫米波雷达、人机交互设备、BlackBox等硬件) Open Software Platform (开放软件平台:包括实时操作系统、承载所有模块的框架层、高精地图与定位模块、感知模块、决策规划模块、控制模块) Cloud Service Platform (云端服务平台:包括高精地图、模拟驾驶的仿真服务、数据平台、安全和OTA服务等)

Apollo 2.0最新开放的模块包括了Security、Camera、Radar和Black Box,这意味着Apollo平台开放了云端服务、服务平台、参考硬件平台以及参考车辆平台在内的四大模块。Apollo 2.0新开放的安全和OTA升级服务,只允许正确和被保护的数据进入车内,并进一步强化了自定位、感知、规划决策和云端方阵等能力。其中Black Box模块包括了软件和硬件系统,能够实现安全存储和大容量数据集传输,可以帮助我们及时发现异常情况,提升整个平台的安全可靠性。

硬件方面,增加两个前向摄像头(长焦+短焦)主要用于识别红绿灯,正前方保险杠上方新安装了毫米波雷达。在Apollo 2.0开放了Camera和Radar的模块后,整个平台具备传感器融合的初步能力,增强了对昼夜简单城市道路工况的适应能力。 在今年的春晚上,百度Apollo开放平台率百余辆车队上了港珠澳大桥,并在自动驾驶模式下完成“8”字交叉跑的高难度动作。

在Apollo 2.0里面提供了什么样的自动驾驶能力?在定位和控制的基础上,添加了感知和决策规划控制,这样就可以完成车辆的自动驾驶闭环。主流的传感器包括摄像头、雷达和激光雷达。每一种传感器都是既有长处也有短板。例如摄像头对于障碍物分类有很好的表现,但想对障碍物速度做准确判断,摄像头就很难做到了。 对于雷达(Radar)来说,在距离和速度判断上有优势,穿透力非常好,但对于障碍物的分类能力,就比较弱了。 激光雷达通过主动发射能量,依靠回波来检测,所以对于判断障碍物的远近,例如暗光条件下障碍物的状态有优势。但是激光雷达目前还非常昂贵。所以,我们要把这些传感器融合在一起,发挥各自所长。

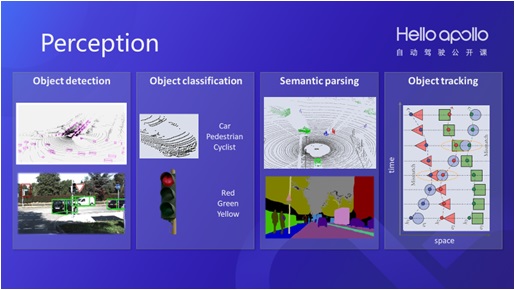

装好传感器以后要有感知系统,而感知又分很多种,如:障碍物识别、障碍物分类、语义分割、目标跟踪,我们是怎么做的呢?

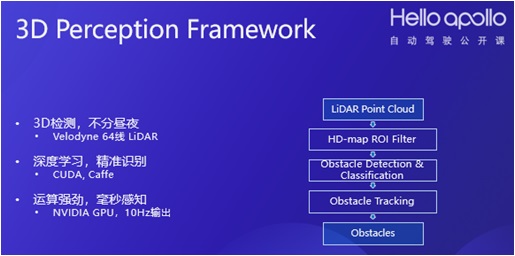

在Apollo中,我们以3D障碍物检测为例,介绍感知的流程。基于LiDAR的3D障碍物感知,其好处是可以不分昼夜并连续检测;我们在框架中使用深度学习,这样就可以很精准识别一些传统规则并解决很多疑难问题;我们使用了NVIDIA GPU,这样可以把巨大运算负载放在GPU上完成,从而高效率的进行感知处理。 为了识别一个障碍物,主要步骤是通过高精地图配置一个ROI过滤器,过滤出我们认为有效的数据;接着把特征值计算出来,通过CNN来完成每个区域的Segmentation,这样就可以有效地识别出物体;通过MinBox,完成障碍物边框构建;最后通过HM对象跟踪就可以感知到障碍物的轨迹,计算速度。

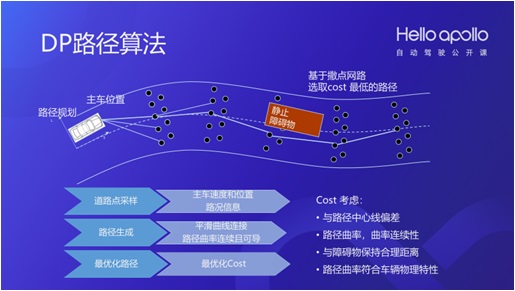

做三维检测的时候需要处理激光点云,根据高精地图把我们感兴趣的部分过滤出来,激光点云做特征化后,导入CNN网络,通过边缘识别合成一个一个物体,最后就可以把物体在坐标系中表达出来。通过把不同帧上的物体串联在一起,可以完成对物体的追踪。有了不同帧上的物体轨迹,就可以知道它的位置,它的速度是多少。在Apollo上有Lidar的检测,有毫米波的检测,还有基于图像的红绿灯的识别,这些东西如何融合到一起?多传感器融合,依赖于Perception fusion DAG框架。如下图所示,通过构造算法subnode,并且通过DAG描述连接到一起,开发者就可以完成定制的多传感器感知和融合。

“云+端”研发迭代新模式 Cloud + Vehicles 从上面的自动驾驶开发过程可以看到,百度Apollo采用了“云+端”研发迭代新模式,加速自动驾驶汽车研发效率。百度在自动驾驶研发中积累海量的数据,把这些积累的数据用云端的服务器集群高效地生成人工智能的模型,也就是车辆大脑。把汽车大脑更新到车辆上,车辆就被赋予了自动驾驶的能力。

自动驾驶数据可以分为四大类:自动驾驶车辆产生的数据首先是原始数据。主要是传感器数据、车辆自身数据、驾驶行为数据等。这些数据的特点是数据量极大、类型多样、以非结构化半结构化数据为主。无论对存储、传输、处理都构成比较大的挑战。

数据平台是百度支撑智能汽车的“云+端”研发迭代新模式的核心平台。由数据采集与传输,自动驾驶数据仓库,自动驾驶计算平台三个部分构成。首先是数据采集与传输部分。使用Data-Recorder会按Apollo数据规范产生,完整的、精确记录的数据包,可以完成问题复现,也同时完成数据积累。通过传输接口,可以将数据高效地传输到运营点和云集群中。

接着是自动驾驶数据仓库部分,会将全部海量数据成体系地组织在一起,快速搜索,灵活使用,为数据流水线和各业务应用提供数据支撑。 自动驾驶计算平台部分,基于云资源异构计算硬件提供超强算力,通过细粒度容器调度提供多种计算模型,来支撑起各业务应用。如训练平台、仿真平台、车辆标定平台等等。为了在深度学习中使用数据,还需要大量标注数据。百度标记数据集中,主要有红绿灯数据集,障碍物数据集(2D、3D),语义分割数据集,自由空间数据集,行为预测数据集等等。为了刻画自动驾驶行为,还需要将数据抽象成逻辑数据。主要是完美感知数据,环境抽象数据,车辆动力学模型等。 最后,我们还为仿真构建仿真数据,主要是参数模糊化数据,三维重建数据,互动行为数据等。

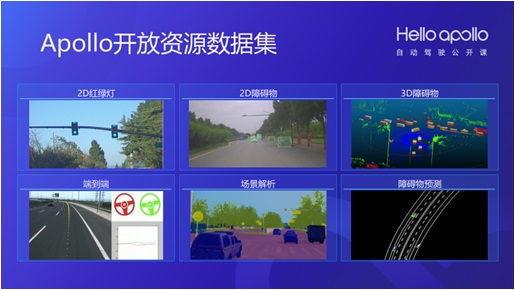

Apollo开放了6个标注数据集: 激光点云障碍物检测分类 提供三维点云标注数据,标注四类障碍物:行人、机动车、非机动车及其他,可用于障碍物检测和分类算法的研发和评测。

红绿灯检测 提供了常见竖式红绿灯的图像数据。采集时段为白天,采集天气覆盖晴天、阴天和雾天,分辨率为1080P。

Road Hackers 本数据集有两种主要类型数据,街景图像和车辆运动状态。街景图像提供车前图像,车辆运动状态数据则包括车辆的当前速度和轨迹曲率。

基于图像的障碍物检测分类 数据采集涵盖城市道路和高速场景,由人工标注出四大类障碍物:机动车、非机动车、行人及静态障碍物,可用于视觉障碍物检测识别算法的研发和评测。

障碍物轨迹预测 采样数据来源于多源传感器的综合抽象特征,每组数据提供62维车辆和道路相关信息,可用于障碍物行为预测算法的研发和评测。

场景解析。数据包括了上万帧的高分辨率RGB视频和与其对应的逐像素语义标注,同时,提供了具有语义分割测量级别的稠密点云、紧急情况的立体视频以及立体全景图像。

此外,我们还开放了ApolloScape数据集,目前规划到20万帧级别,在3月8日已经开放了第一批,有8万帧的数据集,是用相机以及激光雷达扫描的场景。ApolloScape对整个学术界都会有比较大的帮助,已经公开的数据中无论是数据本身还是质量都有一些特色。我们还跟会在近期发布一些,希望大家也能参与到整个算法中来。

百度还通过Apollo训练平台为每一个数据集提供类配套的计算能力。训练平台的特色是:通过Docker+GPU集群,提供与车端的一致硬件计算能力。集成多种框架,提供完整的深度学习解决方案。通过交互式可视化结果分析,方便算法调试优化。

在自动驾驶的算法开发中,最大的痛点之一就是需要对海量数据集,反复尝试。通过将深度学习算法的研发流程(开发、训练、验证、调试)在云端实现,可以在充分利用云端大量计算资源的同时,将数据的流动仅在云端的服务器内完成,从而大幅提高算法研发效率。具体来说,首先开发者在本地开发机中基于Docker开发算法,并部署依赖环境。接着将开发好的环境推到云端的私有Docker Repository中。

|